图1。测试灰度图像Frisco(一),机场(c(c))和迭戈(e(电子))、所有尺寸均为512×512像素,以及这些测试图像的编码器AGU的量化步长(QS)对所考虑指标(PSNR、PSNR-HVS、PSRN-HVS-M,均以dB为单位)的依赖性((b), (d日)、和(如果))。

图1。测试灰度图像Frisco(一),机场(c(c))和迭戈(e(电子))、所有尺寸均为512×512像素,以及这些测试图像的编码器AGU的量化步长(QS)对所考虑指标(PSNR、PSNR-HVS、PSRN-HVS-M,均以dB为单位)的依赖性((b), (d日)、和(如果))。

图2。三通道测试图像:原始(一),它的三个组件(b–d日),通过提供PSNR-HVS-M=36 dB进行压缩(e(电子)),通过提供PSNR-HVS-M=30 dB进行压缩(如果).

图2。三通道测试图像:原始(一),它的三个组件(b–d日),通过提供PSNR-HVS-M=36 dB进行压缩(e(电子)),通过提供PSNR-HVS-M=30 dB进行压缩(如果).

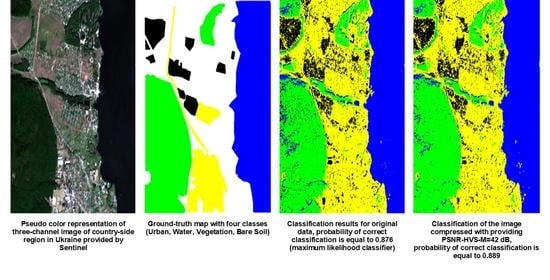

图3。分类结果:真实地图(一); 原始图像分类图(b); PSNR-HVS-M=36 dB压缩图像的分类图(c(c)); PSNR-HVS-M=30dB压缩图像的分类图(d日).

图3。分类结果:真实地图(一); 原始图像分类图(b); PSNR-HVS-M=36 dB压缩图像的分类图(c(c)); PSNR-HVS-M=30dB压缩图像的分类图(d日).

图4。使用针对同一压缩图像训练的最大似然法(MLM)分类器提供PSNR-HVS-M=36 dB的压缩图像分类图(一); 使用针对同一压缩图像训练的MLM分类器提供PSNR-HVS-M=30 dB的压缩图像(b).

图4。使用针对同一压缩图像训练的最大似然法(MLM)分类器提供PSNR-HVS-M=36 dB的压缩图像分类图(一); 使用针对同一压缩图像训练的MLM分类器提供PSNR-HVS-M=30 dB的压缩图像(b).

图5。分类结果:对于压缩图像(PSNR-HVS-M=42 dB)(一),用于压缩图像(PSNR-HVS-M=36 dB)(b); 对于压缩(PSNR-HVS-M=30 dB)(c(c)).

图5。分类结果:对于压缩图像(PSNR-HVS-M=42 dB)(一),用于压缩图像(PSNR-HVS-M=36 dB)(b); 对于压缩(PSNR-HVS-M=30 dB)(c(c)).

图6。同一图像的神经网络训练图像分类结果:原始(一),用PSNR-HVS-M压缩=42 dB(b),用PSNR-HVS-M压缩=36 dB(c(c)),用PSNR-HVS-M压缩=30 dB(d日).

图6。同一图像的神经网络训练图像分类结果:原始(一),用PSNR-HVS-M压缩=42 dB(b),用PSNR-HVS-M压缩=36 dB(c(c)),用PSNR-HVS-M压缩=30 dB(d日).

图7。伪彩色表示中的三通道图像(一); 用于训练的像素组(b),用于验证的像素组(c(c)).

图7。伪彩色表示中的三通道图像(一); 用于训练的像素组(b),用于验证的像素组(c(c)).

图8。伪彩色表示的三通道图像:通过提供PSNR-HVS-M=42 dB进行压缩(一),通过提供PSNR-HVS-M=36 dB进行压缩(b); 通过提供PSNR-HVS-M=30 dB进行压缩(c(c)).

图8。伪彩色表示的三通道图像:通过提供PSNR-HVS-M=42 dB进行压缩(一),压缩后提供PSNR-HVS-M=36 dB(b); 通过提供PSNR-HVS-M=30 dB进行压缩(c(c)).

图9。分类结果:对于原始图像(一),用于压缩图像(PSNR-HVS-M=36 dB)(b),用于压缩(PSNR-HVS-M=30 dB)(c(c)).

图9。分类结果:对于原始图像(一),用于压缩图像(PSNR-HVS-M=36 dB)(b),用于压缩(PSNR-HVS-M=30 dB)(c(c)).

图10。基于NN的方法提供的分类结果:对于原始图像(一),用于压缩图像(PSNR-HVS-M=36 dB)(b); 对于压缩(PSNR-HVS-M=30 dB)(c(c)).

图10。基于NN的方法提供的分类结果:对于原始图像(一),用于压缩图像(PSNR-HVS-M=36 dB)(b); 对于压缩(PSNR-HVS-M=30 dB)(c(c)).

图11。Staryi Saltiv Sentinel-2图像片段(一)和哈尔科夫北部(b).

图11。Staryi Saltiv Sentinel-2图像片段(一)和哈尔科夫北部(b).

图12。PSNR-HVS-M对九张测试图像的QS的依赖性(参见图上部的列表)和AGU的平均曲线。

图12。PSNR-HVS-M对九张测试图像的QS的依赖性(参见图上部的列表)和AGU的平均曲线。

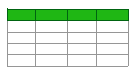

表2。特定类别的正确分类概率取决于图像质量。

| PSNR-HVS-M,分贝 | P(P)11 | P(P)22 | P(P)33 | P(P)44 | P(P)55 | P(P)66 | P(P)77 |

|---|

| ∞(原始图像) | 0.475 | 0.667 | 0.773 | 0.854 | 0.193 | 0.822 | 0.415 |

| 48 | 0.190 | 0.781 | 0.686 | 0.384 | 0.093 | 0.809 | 0.579 |

| 45 | 0.147 | 0.795 | 0.652 | 0.308 | 0.077 | 0.777 | 0.623 |

| 42 | 0.101 | 0.804 | 0.615 | 0.253 | 0.058 | 0.712 | 0.665 |

| 36 | 0.031 | 0.802 | 0.568 | 0.163 | 0.040 | 0.545 | 0.777 |

| 30 | 0.001 | 0.753 | 0.478 | 0.177 | 0.042 | 0.556 | 0.843 |

表5。不同图像的正确分类Pcc的总概率取决于“训练”数据。

表5。不同图像的正确分类Pcc的总概率取决于“训练”数据。

| 用于培训的图像 | 压缩图像正确分类的总概率 |

|---|

| PSNR-HVS-M=42分贝 | PSNR-HVS-M=36分贝 | PSNR-HVS-M=30分贝 |

|---|

| 0 | 原始(未压缩) | 0.501 | 0.434 | 0.442 |

| 1 | 通过提供PSNR-HVS-M压缩=42 dB | 0.579 | 0.566 | 0.563 |

| 2 | 通过提供PSNR-HVS-M=36 dB进行压缩 | 0.519 | 0.597 | 0.599 |

| 三 | 通过提供PSNR-HVS-M=30 dB进行压缩 | 0.408 | 0.446 | 0.527 |

表6。由神经网络(NN)为该图像训练的原始图像分类的混淆矩阵。

表6。由神经网络(NN)为该图像训练的原始图像分类的混淆矩阵。

| 等级 | 决策概率 |

|---|

| 道路 | 字段-Y | 字段-R | 水 | 草地 | 树 | 纹理 |

|---|

| 道路 | 0.356 | 0.645 | 0 | 0 | 0 | 0 | 0 |

| 字段-Y | 0.109 | 0.608 | 0.002 | 0 | 0 | 0 | 0.281 |

| 字段-R | 0 | 0.004 | 0.996 | 0 | 0 | 0 | 0 |

| 水 | 0 | 0 | 0 | 0.986 | 0 | 0 | 0.014 |

| 草地 | 0 | 0 | 0 | 0 | 0.744 | 0.245 | 0.012 |

| 树 | 0 | 0 | 0 | 0 | 0.072 | 0.923 | 0.005 |

| 纹理 | 0 | 0.03 | 0 | 0.26 | 0.116 | 0.153 | 0.441 |

表7。神经网络分类的压缩图像的混淆矩阵用于训练原始图像并应用于压缩图像(PSNR-HVS-M=42 dB)。

表7。神经网络分类的压缩图像的混淆矩阵用于训练原始图像并应用于压缩图像(PSNR-HVS-M=42 dB)。

| 等级 | 决策概率 |

|---|

| 道路 | 字段Y | 字段-R | 水 | 草地 | 树 | 纹理 |

|---|

| 道路 | 0.299 | 0.699 | 0 | 0 | 0 | 0 | 0 |

| 字段-Y | 0.089 | 0.627 | 0 | 0 | 0 | 0 | 0.276 |

| 字段-R | 0 | 0.018 | 0.982 | 0 | 0 | 0 | 0 |

| 水 | 0 | 0 | 0 | 0.980 | 0 | 0 | 0.020 |

| 草地 | 0 | 0 | 0 | 0 | 0.753 | 0.219 | 0.028 |

| 树 | 0 | 0 | 0 | 0 | 0.084 | 0.911 | 0.006 |

| 纹理 | 0 | 0.03 | 0 | 0.26 | 0.116 | 0.153 | 0.441 |

表8。神经网络分类的压缩图像的混淆矩阵用于训练原始图像并应用于压缩图像(PSNR-HVS-M=36 dB)。

表8。神经网络分类的压缩图像的混淆矩阵用于训练原始图像并应用于压缩图像(PSNR-HVS-M=36 dB)。

| 等级 | 决策概率 |

|---|

| 道路 | 字段-Y | 字段-R | 水 | 草地 | 树 | 纹理 |

|---|

| 道路 | 0.271 | 0.728 | 0.001 | 0 | 0 | 0 | 0 |

| 字段-Y | 0.078 | 0.631 | 0.012 | 0 | 0.001 | 0 | 0.279 |

| 字段-R | 0 | 0.027 | 0.973 | 0 | 0 | 0 | 0 |

| 水 | 0 | 0 | 0 | 0.979 | 0 | 0 | 0.021 |

| 草地 | 0 | 0 | 0 | 0 | 0.721 | 0.22 | 0.059 |

| 树 | 0 | 0 | 0 | 0 | 0.078 | 0.915 | 0.007 |

| 纹理 | 0 | 0.049 | 0 | 0.253 | 0.123 | 0.148 | 0.426 |

表9。神经网络分类的压缩图像的混淆矩阵用于训练原始图像并应用于压缩图像(PSNR-HVS-M=30dB)。

表9。神经网络分类的压缩图像的混淆矩阵用于训练原始图像并应用于压缩图像(PSNR-HVS-M=30dB)。

| 等级 | 决策概率 |

|---|

| 道路 | 字段-Y | 字段-R | 水 | 草地 | 树 | 纹理 |

|---|

| 道路 | 0.217 | 0.766 | 0 | 0 | 0 | 0 | 0.017 |

| 字段-Y | 0.067 | 0.646 | 0.007 | 0 | 0.005 | 0 | 0.275 |

| 字段-R | 0 | 0.05 | 0.946 | 0.004 | 0 | 0 | 0 |

| 水 | 0 | 0 | 0 | 0.992 | 0 | 0 | 0.008 |

| 草地 | 0 | 0 | 0 | 0 | 0.658 | 0.21 | 0.131 |

| 树 | 0 | 0 | 0 | 0 | 0.051 | 0.925 | 0.025 |

| 纹理 | 0 | 0.067 | 0 | 0.243 | 0.141 | 0.131 | 0.418 |

表10。通过训练神经网络对压缩图像进行分类的混淆矩阵(PSNR-HVS-M=42 dB)。

表10。通过训练神经网络对压缩图像进行分类的混淆矩阵(PSNR-HVS-M=42 dB)。

| 等级 | 决策概率 |

|---|

| 道路 | 字段-Y | 字段-R | 水 | 草地 | 树 | 纹理 |

|---|

| 道路 | 0.455 | 0.545 | 0.001 | 0 | 0 | 0 | 0 |

| 字段-Y | 0.137 | 0.561 | 0.014 | 0 | 0 | 0 | 0.289 |

| 字段-R | 0 | 0.026 | 0.974 | 0 | 0 | 0 | 0 |

| 水 | 0 | 0 | 0 | 0.961 | 0 | 0 | 0.039 |

| 草地 | 0 | 0 | 0 | 0 | 0.820 | 0.165 | 0.015 |

| 树 | 0 | 0 | 0 | 0 | 0.068 | 0.929 | 0.004 |

| 纹理 | 0 | 0.029 | 0 | 0.234 | 0.124 | 0.153 | 0.461 |

表11。通过训练神经网络对压缩图像进行分类的混淆矩阵(PSNR-HVS-M=36 dB)。

表11。通过训练神经网络对压缩图像进行分类的混淆矩阵(PSNR-HVS-M=36 dB)。

| 等级 | 决策概率 |

|---|

| 道路 | 字段-Y | 字段-R | 水 | 草地 | 树 | 纹理 |

|---|

| 道路 | 0.507 | 0.492 | 0.002 | 0 | 0 | 0 | 0 |

| 字段-Y | 0.127 | 0.562 | 0.005 | 0 | 0.001 | 0 | 0.305 |

| 字段-R | 0 | 0.069 | 0.931 | 0 | 0 | 0 | 0 |

| 水 | 0 | 0 | 0 | 0.989 | 0 | 0 | 0.01 |

| 草地 | 0 | 0 | 0 | 0 | 0.901 | 0.087 | 0.013 |

| 树 | 0 | 0 | 0 | 0 | 0.039 | 0.956 | 0.005 |

| 纹理 | 0 | 0.029 | 0 | 0.236 | 0.142 | 0.141 | 0.452 |

表12。通过训练神经网络对压缩图像进行分类的混淆矩阵(PSNR-HVS-M=30dB)。

表12。由针对该图像训练的NN分类的压缩图像的混淆矩阵(PSNR-HVS-M=30dB)。

| 等级 | 决策概率 |

|---|

| 道路 | 字段-Y | 字段-R | 水 | 草地 | 树 | 纹理 |

|---|

| 道路 | 0.692 | 0.304 | 0 | 0 | 0.002 | 0.001 | 0.01 |

| 字段-Y | 0.055 | 0.654 | 0.009 | 0 | 0.019 | 0 | 0.263 |

| 字段-R | 0 | 0.033 | 0.967 | 0.004 | 0 | 0 | 0 |

| 水 | 0 | 0 | 0 | 0.994 | 0 | 0 | 0.006 |

| 草地 | 0 | 0 | 0 | 0 | 0.939 | 0.035 | 0.026 |

| 树 | 0 | 0 | 0 | 0 | 0.023 | 0.972 | 0.005 |

| 纹理 | 0 | 0.049 | 0 | 0.221 | 0.113 | 0.131 | 0.486 |

表13。压缩参数。

| 组件 | 所需PSNR-HVS-M | 质量体系 | 提供PSNR-HVS-M | 铬 |

|---|

| 伪红色 | 42分贝 | 17.372 | 41.941 | 6.008 |

| 36分贝 | 29.825 | 36.059 | 8.952 |

| 30分贝 | 55.558 | 30.007 | 16.503 |

| 伪绿色 | 42分贝 | 17.285 | 41.936 | 5.994 |

| 36分贝 | 29.856 | 35.992 | 8.968 |

| 30分贝 | 55.134 | 29.996 | 16.445 |

| 伪蓝色 | 42分贝 | 17.227 | 41.847 | 6.016 |

| 36分贝 | 29.729 | 35.998 | 8.993 |

| 30分贝 | 55.014 | 30.0008 | 16.577 |

表14。MLM方法的分类概率针对原始图像进行训练并应用于原始图像。

表14。MLM方法的分类概率针对原始图像进行训练并应用于原始图像。

| 等级 | 决策概率 |

|---|

| 土壤 | 草地 | 水 | 城市的 | 灌木丛 |

|---|

| 土壤 | 0.747 | 0.027 | 0 | 0.037 | 0.189 |

| 草地 | 0.173 | 0.812 | 0 | 0.008 | 0.007 |

| 水 | 0 | 0 | 0.967 | 0 | 0.033 |

| 城市的 | 0.004 | 0 | 0 | 0.989 | 0.007 |

| 灌木丛 | 0.091 | 0.068 | 0.013 | 0.016 | 0.812 |

表15。为原始图像训练并应用于压缩图像的MLM方法的分类概率(混淆矩阵)(PSNR-HVS-M=42dB)。

表15。MLM方法的分类概率(混淆矩阵)针对原始图像进行训练,并应用于压缩图像(PSNR-HVS-M=42 dB)。

| 等级 | 决策概率 |

|---|

| 土壤 | 草地 | 水 | 城市的 | 灌木丛 |

|---|

| 土壤 | 0.732 | 0.025 | 0 | 0.043 | 0.199 |

| 草地 | 0.177 | 0.808 | 0 | 0.008 | 0.006 |

| 水 | 0 | 0 | 0.963 | 0 | 0.037 |

| 城市的 | 0.005 | 0 | 0 | 0.987 | 0.008 |

| 灌木丛 | 0.118 | 0.07 | 0.014 | 0.018 | 0.779 |

表16。针对原始图像训练MLM并应用于压缩图像的分类概率(混淆矩阵)(PSNR-HVS-M=36 dB)。

表16。针对原始图像训练MLM并应用于压缩图像的分类概率(混淆矩阵)(PSNR-HVS-M=36 dB)。

| 等级 | 决策概率 |

|---|

| 土壤 | 草地 | 水 | 城市的 | 灌木丛 |

|---|

| 土壤 | 0.744 | 0.028 | 0 | 0.043 | 0.185 |

| 草地 | 0.185 | 0.799 | 0 | 0.009 | 0.007 |

| 瓦特» | 0 | 0 | 0.959 | 0 | 0.041 |

| 城市的 | 0.005 | 0 | 0 | 0.985 | 0.010 |

| 灌木丛 | 0.133 | 0.074 | 0.016 | 0.018 | 0.758 |

表17。针对原始图像训练MLM并应用于压缩图像的分类概率(混淆矩阵)(PSNR-HVS-M=30 dB)。

表17。针对原始图像训练MLM并应用于压缩图像的分类概率(混淆矩阵)(PSNR-HVS-M=30 dB)。

| 等级 | 决策概率 |

|---|

| 土壤 | 草地 | 水 | 城市的 | 灌木丛 |

|---|

| 土壤 | 0.724 | 0.026 | - | 0.044 | 0.206 |

| 草地 | 0.178 | 0.809 | 0 | 0.006 | 0.007 |

| 水 | - | 0 | 0.942 | 0 | 0.058 |

| 城市的 | 0.007 | - | 0 | 0.982 | 0.011 |

| 灌木丛 | 0.145 | 0.079 | 0.016 | 0.019 | 0.741 |

表18。基于NN的方法对原始图像进行训练并应用于原始图像的分类概率。

表18。基于NN的方法对原始图像进行训练并应用于原始图像的分类概率。

| 等级 | 决策概率 |

|---|

| 土壤 | 草地 | 水 | 城市的 | 灌木丛 |

|---|

| 土壤 | 0.950 | 0 | 0 | 0 | 0.05 |

| 草地 | 0 | 1 | 0 | 0 | 0 |

| 水 | 0 | 0 | 0.952 | 0 | 0.048 |

| 城市的 | 0.098 | 0 | 0 | 0.767 | 0.135 |

| 灌木丛 | 0.187 | 0.009 | 0.02 | 0.009 | 0.774 |

表19。基于NN的方法的分类概率(混淆矩阵)针对原始图像进行训练,并应用于压缩图像(PSNR-HVS-M=42 dB)。

表19。基于NN的方法的分类概率(混淆矩阵)针对原始图像进行训练,并应用于压缩图像(PSNR-HVS-M=42 dB)。

| 等级 | 决策概率 |

|---|

| 土壤 | 草地 | 水 | 城市的 | 灌木丛 |

|---|

| 土壤 | 0.942 | 0 | 0 | 0 | 0.058 |

| 草地 | 0 | 0.999 | 0 | 0 | 0.001 |

| 水 | 0 | 0 | 0.942 | 0 | 0.058 |

| 城市的 | 0.01 | 0 | 0 | 0.765 | 0.136 |

| 灌木丛 | 0.207 | 0.016 | 0.018 | 0.009 | 0.751 |

表20。基于NN的方法的分类概率(混淆矩阵)针对原始图像进行训练,并应用于压缩图像(PSNR-HVS-M=36 dB)。

表20。基于NN的方法的分类概率(混淆矩阵)针对原始图像进行训练,并应用于压缩图像(PSNR-HVS-M=36 dB)。

| 等级 | 决策概率 |

|---|

| 土壤 | 草地 | 水 | 城市的 | 灌木丛 |

|---|

| 土壤 | 0.944 | 0 | 0 | 0 | 0.057 |

| 草地 | 0 | 1 | 0 | 0 | 0 |

| 水 | 0 | 0 | 0.941 | 0 | 0.059 |

| 城市的 | 0.108 | 0 | 0 | 0.761 | 0.131 |

| 灌木丛 | 0.236 | 0.022 | 0.017 | 0.007 | 0.718 |

表21。为原始图像训练并应用于压缩图像的基于NN的方法的分类概率(混淆矩阵)(PSNR-HVS-M=30dB)。

表21。基于NN的方法的分类概率(混淆矩阵)针对原始图像进行训练,并应用于压缩图像(PSNR-HVS-M=30 dB)。

| 等级 | 决策概率 |

|---|

| 土壤 | 草地 | 水 | 城市的 | 灌木丛 |

|---|

| 土壤 | 0.941 | 0 | 0 | 0 | 0.059 |

| 草地 | 0 | 0.999 | 0 | 0 | 0.001 |

| 水 | 0.001 | 0 | 0.919 | 0 | 0.08 |

| 城市的 | 0.099 | 0 | 0 | 0.747 | 0.153 |

| 灌木丛 | 0.247 | 0.028 | 0.014 | 0.004 | 0.707 |

表22。两组三个编码器的实际数据CR比较。

| 颜色 | 所需PSNR-HVS-M | AGU的CR | SPIHT的CR | ADCTC的CR |

|---|

| 伪红色,集1 | 45 | 10.338 | 9.467 | 11.306 |

| 39 | 18.383 | 16.631 | 20.362 |

| 33 | 32.929 | 29.303 | 36.465 |

| 伪红色,集2 | 45 | 3.317 | 3.283 | 3.498 |

| 39 | 4.520 | 4.762 | 4.886 |

| 33 | 7.121 | 7.360 | 7.986 |

| 伪绿色,集1 | 45 | 7.179 | 5.957 | 7.513 |

| 39 | 12.666 | 10.914 | 13.513 |

| 33 | 23.907 | 20.833 | 26.030 |

| 伪绿色,集2 | 45 | 3.214 | 3.150 | 3.363 |

| 39 | 4.356 | 4.564 | 4.684 |

| 33 | 6.784 | 7.105 | 7.573 |

| 伪蓝色,集1 | 45 | 6.665 | 5.727 | 7.216 |

| 39 | 11.942 | 10.336 | 12.740 |

| 33 | 24.914 | 22.346 | 27.191 |

| 伪蓝色,集2 | 45 | 3.212 | 3.252 | 3.418 |

| 39 | 4.314 | 4.698 | 4.785 |

| 33 | 6.882 | 7.380 | 7.817 |

表23。集1、AGU编码器、NN分类器的正确分类概率取决于压缩图像质量。

表23。集1、AGU编码器、NN分类器的正确分类概率取决于压缩图像质量。

| 课程 | 第1阶段 | SS1_45型 | SS1_42型 | SS1_39型 | SS1_36型 | SS1_33型 | SS1_30型 |

|---|

| 城市的 | 0.774 | 0.777 | 0.775 | 0.777 | 0.778 | 0.773 | 0.786 |

| 水 | 0.998 | 0.998 | 0.998 | 0.999 | 0.999 | 0.999 | 0.998 |

| 植被 | 0.915 | 0.913 | 0.914 | 0.915 | 0.918 | 0.921 | 0.927 |

| 裸土 | 0.809 | 0.811 | 0.809 | 0.809 | 0.812 | 0.798 | 0.801 |

| P(P)全部的 | 0.874 | 0.875 | 0.874 | 0.875 | 0.877 | 0.873 | 0.878 |

表24。集2、AGU编码器、NN分类器的正确分类概率取决于压缩图像质量。

表24。正确分类的概率取决于集合2、AGU编码器、NN分类器的压缩图像质量。

| 课程 | 第二阶段 | SS2_45型 | SS2_42型 | SS2_39号 | SS2_36号 | SS2_33号 | 第2卷第30页 |

|---|

| 城市的 | 0.877 | 0.872 | 0.871 | 0.865 | 0.861 | 0.861 | 0.864 |

| 水 | 0.654 | 0.659 | 0.662 | 0.661 | 0.654 | 0.644 | 0.647 |

| 植被 | 0.857 | 0.825 | 0.815 | 0.801 | 0.788 | 0.797 | 0.788 |

| 裸土 | 0.890 | 0.867 | 0.865 | 0.869 | 0.866 | 0.860 | 0.870 |

| P(P)全部的 | 0.820 | 0.810 | 0.803 | 0.799 | 0.792 | 0.791 | 0.792 |

表25。集1、AGU编码器、ML分类器的正确分类概率取决于压缩图像质量。

表25。正确分类的概率取决于集合1、AGU编码器、ML分类器的压缩图像质量。

| 课程 | 第1阶段 | SS1_45型 | SS1_42型 | SS1_39型 | SS1_36型 | SS1_33型 | SS1_30型 |

|---|

| 城市的 | 0.695 | 0.727 | 0.727 | 0.735 | 0.745 | 0.743 | 0.771 |

| 水 | 0.979 | 0.99 | 0.992 | 0.992 | 0.993 | 0.992 | 0.988 |

| 植被 | 0.9 | 0.896 | 0.896 | 0.895 | 0.899 | 0.901 | 0.902 |

| 裸土 | 0.85 | 0.852 | 0.851 | 0.849 | 0.852 | 0.831 | 0.826 |

| P(P)全部的 | 0.856 | 0.866 | 0.866 | 0.868 | 0.872 | 0.867 | 0.872 |

表26。集2、AGU编码器、ML分类器的正确分类概率取决于压缩图像质量。

表26。集2、AGU编码器、ML分类器的正确分类概率取决于压缩图像质量。

| 课程 | 第二阶段 | SS2_45型 | SS2_42型 | SS2_39号 | SS2_36号 | SS2_33号 | SS2_30型 |

|---|

| 城市的 | 0.917 | 0.914 | 0.913 | 0.913 | 0.91 | 0.913 | 0.918 |

| 水 | 0.923 | 0.902 | 0.893 | 0.885 | 0.873 | 0.873 | 0.857 |

| 植被 | 0.691 | 0.667 | 0.647 | 0.645 | 0.634 | 0.631 | 0.619 |

| 裸土 | 0.856 | 0.819 | 0.815 | 0.817 | 0.812 | 0.802 | 0.812 |

| P(P)全部的 | 0.847 | 0.826 | 0.817 | 0.815 | 0.807 | 0.805 | 0.801 |

表27。集1、SPIHT编码器、ML分类器的正确分类概率取决于压缩图像质量。

表27。集1、SPIHT编码器、ML分类器的正确分类概率取决于压缩图像质量。

| 课程 | 第1阶段 | SS1_45型 | SS1_42型 | SS1_39型 | SS1_36型 | SS1_33型 | SS1_30型 |

|---|

| 城市的 | 0.695 | 0.721 | 0.724 | 0.728 | 0.735 | 0.742 | 0.759 |

| 水 | 0.979 | 0.991 | 0.991 | 0.993 | 0.993 | 0.992 | 0.985 |

| 植被 | 0.9 | 0.899 | 0.901 | 0.9 | 0.904 | 0.908 | 0.906 |

| 裸土 | 0.85 | 0.856 | 0.864 | 0.858 | 0.858 | 0.848 | 0.816 |

| P(P)全部的 | 0.856 | 0.866 | 0.87 | 0.87 | 0.872 | 0.873 | 0.867 |

表28:。集2、SPIHT编码器、ML分类器的正确分类概率取决于压缩图像质量。

表28:。集2、SPIHT编码器、ML分类器的正确分类概率取决于压缩图像质量。

| 课程 | 第二阶段 | SS2_45型 | SS2_42型 | SS2_39号 | SS2_36号 | SS2_33号 | SS2_30型 |

|---|

| 城市的 | 0.917 | 0.915 | 0.915 | 0.917 | 0.916 | 0.92 | 0.924 |

| 水 | 0.923 | 0.918 | 0.913 | 0.903 | 0.892 | 0.884 | 0.875 |

| 植被 | 0.691 | 0.686 | 0.688 | 0.692 | 0.697 | 0.699 | 0.707 |

| 裸土 | 0.856 | 0.847 | 0.858 | 0.862 | 0.853 | 0.861 | 0.859 |

| P(P)全部的 | 0.847 | 0.841 | 0.843 | 0.843 | 0.839 | 0.841 | 0.841 |

表29。集1、ADCTC、ML分类器的正确分类概率取决于压缩图像质量。

表29。集1、ADCTC、ML分类器的正确分类概率取决于压缩图像质量。

| 课程 | 第一阶段 | SS1_45型 | SS1_42型 | SS1_39型 | SS1_36型 | SS1_33型 | SS1_30型 |

|---|

| 城市的 | 0.695 | 0.723 | 0.725 | 0.734 | 0.736 | 0.751 | 0.76 |

| 水 | 0.979 | 0.992 | 0.994 | 0.995 | 0.995 | 0.995 | 0.995 |

| 植被 | 0.9 | 0.898 | 0.9 | 0.901 | 0.901 | 0.91 | 0.913 |

| 裸土 | 0.85 | 0.863 | 0.855 | 0.85 | 0.864 | 0.84 | 0.827 |

| P(P)全部的 | 0.856 | 0.869 | 0.869 | 0.87 | 0.874 | 0.874 | 0.874 |

表30:。集2、ADCTC编码器、ML分类器的正确分类概率取决于压缩图像质量。

表30。集2、ADCTC编码器、ML分类器的正确分类概率取决于压缩图像质量。

| 课程 | 第二阶段 | SS2_45型 | SS2_42型 | SS2_39号 | SS2_36号 | SS2_33号 | SS2_30型 |

|---|

| 城市的 | 0.917 | 0.914 | 0.911 | 0.91 | 0.911 | 0.912 | 0.915 |

| 水 | 0.923 | 0.918 | 0.912 | 0.906 | 0.909 | 0.901 | 0.898 |

| 植被 | 0.691 | 0.674 | 0.688 | 0.682 | 0.664 | 0.67 | 0.693 |

| 裸土 | 0.856 | 0.848 | 0.848 | 0.847 | 0.843 | 0.859 | 0.868 |

| P(P)全部的 | 0.847 | 0.838 | 0.84 | 0.836 | 0.832 | 0.836 | 0.844 |