1.简介

语义分割是计算机视觉领域的主要研究课题之一,是计算机从整体到像素级识别图像信息特征的必要过程。语义分割的核心是根据图像本身的信息特征,如图像像素之间的灰度分布和图像纹理,将图像划分为具有不同语义标签的不重叠子块[1]. 纵向语义切分是语义切分的重要组成部分。肖像语义分割的目的是将肖像语义区域从包含肖像的图片中复杂的背景信息语义区域中分离出来,从而获得良好的肖像边界[2]. 在现实生活中,人们通过摄像机或其他设备将场景转换为图像,然后使用算法对图像中客观肖像对象的语义进行分割和标记,从而实现应用,方便人们的生活。训练有素的高精度肖像分割模型也可以用作整个肖像智能系统的预处理模块,避免了后续操作中对背景等无关信息进行特征提取,从而提高了整个系统的准确性[三]. 然而,真实的人像图像具有不同目标大小和不同背景信息的特点,这使得人像的语义分割具有很大的挑战性。首先,与传统的语义分割相比,纵向语义分割模型需要面对更多目标尺寸较大的图像,这测试了模型的泛化能力,使得模型的分割细节更难保证[4]. 同时,由于人像图像中的背景像素和目标像素相对接近,现有模型在夜间等低光场景中容易出现目标人像丢失和背景误判现象,模型的分割精度需要提高。 为了解决上述问题,本文提出了一种基于双模信息互补的纵向语义分割模型,该模型又基于U-net网络。本文的主要贡献总结如下:

- (1)

在编码器阶段,我们基于RGB模式和灰度模式提取图像特征:将RGB图像和灰度图像同时作为模型编码器的输入,得到相应的特征表示,并进行特征融合。灰度图像可以直接由RGB图像转换,避免了在数据集中采集其他模态图像的开销,实现了双模态下的信息互补和特征提取。灰度图像的特征提取提高了模型在弱光下提取目标图形的能力。

- (2)

我们提出SK-ASSP(Selective Kernel-Atrous Spatial Pyramid Pooling)模块作为编码器阶段的一种新的特征提取模块:SK-ASSP通过软注意,根据图像中目标的大小动态调整不同感受野的空洞卷积的权重,从而为不同尺寸的人像目标提供特征提取能力。同时,SK-ASSP利用边缘优化分支,根据边缘特征图提高目标人像的边缘分割精度。

- (3)

我们提出了混合并行注意机制来改进编解码连接过程:通过并行信道注意模块和位置注意模块,分别捕获输入特征的信道信息和位置信息。

2.相关工程

2.1. 基于CNN的语义分割

卷积神经网络(CNN)可以从训练图像中自动学习不同的混合表征特征,从而对图像进行语义分割[5]. 在此基础上,学者们设计了大量新的高效语义分割算法,其中以U-net为代表的语义分割模型[6]现在已经成为语义分割的流行选择,因为它可以在较小的数据集上表现良好。U-net的结构如所示图1主要分为三个部分:编码器、跳接器和解码器。在U-net网络中,编码器阶段负责图像的特征提取,其中连续的下采样操作允许模型获得图像的低分辨率信息。解码阶段负责对图像特征映射进行约简,从而恢复图像的深层特征信息。跳跃连接阶段将编码器输出特征与解码器阶段特征连接起来,这有助于模型有效融合图像的深层和浅层特征。跳跃连接的建立可以帮助模型在像素级实现语义分割,从而为分割提供更精细的特征。 然而,当U-net应用于人像语义分割领域时,编码器中卷积核的固定接受域使得模型无法自适应调整接受域,从而导致模型无法捕获不同尺寸人像目标的像素信息,导致图像的一些比例信息丢失[7]. 为了解决这些问题,Chen等人[8]提出了deeplad v3+模型,较好地解决了模型无法捕捉图像中不同尺度信息的问题,并提出了Atrous Spatial Pyramid Pooling(ASPP)模块。其中,ASPP模块并行化具有不同扩展率的多个分支的空穴卷积,提取不同大小感觉场的多尺度特征,有助于模型更好地聚焦图像中不同大小目标物体的像素信息[9]. 然而,深层v3+不足以实现要素图的多尺度连接[10]并且由于编码器和解码器之间的直接连接,没有注意编码器和解码器特征之间的语义差距,这可能导致目标边缘边界分割精度较差。为了解决这些问题,Oktay等人[11]提出了注意力U-net,该方法在下采样结果中增加注意力系数,并通过在跳转连接阶段引入注意门来修剪特征映射以减少语义鸿沟。虽然单个注意机制缺乏局部特征信息和全局信息之间的交互作用,但各种注意机制的组合可以帮助模型更加关注像素位置信息[12]. 在这方面,通过链接跳跃阶段的多个注意机制,我们可以获得通道或空间等多维特征向量的注意权重,从而为下采样结果提供更深入的信息,从而缩小上采样结果和下采样结果之间的语义差距[13,14]. 2.2. 跨模态的语义分割

不同模态的图像关注图像的不同特征信息,学者们认为,使用多种模态的图像进行语义分割有助于捕获从不同聚焦的图像中提取的特征,提供补充信息,帮助提高网络的辨别能力[15]. Zhang等人[16]提出在双编码器结构中,从红外图像模态和RGB图像模态两种模态中提取关键信息,然后通过注意模块进行融合,可以有效地改善建模夜景的语义分割。ABHINAV等人[17]在多模态分割的基础上,在分割模型中引入了自监督模型,并使用自适应融合机制将编码器中的多个特征集成到单个解码器中,动态调整不同场景中不同模态特征的权重,从而提高了模型在各种复杂场景中的泛化能力。这是基于上述思想,同时,由于灰度图像比RGB图像更注重对象的亮度、结构和形状。因此,基于RGB和灰度图像两种模式的语义分割模型可以有效解决弱光场景中分割精度差的问题。 然而,另一方面,如果直接总结图像不同模式的特征映射,则多模态语义分割的优势将无法得到充分利用。因此,学者们大多使用注意模块对多模态的特征映射进行特征融合,然后在信息交互后获得特征映射[18]. Wang等人[19]提出了MCF模块,该模块通过空间上下文融合(SCF)块提取多尺度空间信息,并通过压缩学习平衡信道特征进行多模式特征融合。此外,Li等人[20]通过引入多注意力机制对多模态的特征相关性进行建模,以获得信息交互后的特征表示。 3.方法

3.1. 总体架构

本文提出的模型主要分为三个部分:编码器、Skip连接和解码器。结构如所示图2. 编码器部分由两个分支组成:RGB图像输入和灰度图像输入。在两种模式下输入的每个图像将首先进行3×3卷积,以获得两种模式中的浅层特征。然后,进行三次连续的下采样操作:首先,进入SK-ASSP模块,获得相应模式下的特征图,然后将RGB和灰度两个分支的输出输入到交叉模式互补模块进行特征融合,得到这一层的下采样结果。总共进行3次下采样操作后,输入解码器进行上采样操作。

在跳接部分,本文采用了混合并行注意模块。在该模块中,在通道维度和坐标维度上同时进行注意力操作,以捕捉特征中的局部和全局空间信息,并挖掘空间和通道维度上肖像图像的上下文相关信息。

在解码部分,使用三个连续的上采样块将特征图像恢复到相应的大小。每次上采样后,图像大小都会变大。本文将原有的U-Net结构特征图拼接操作改为逐像素相加,从而降低了维数。最后,通过3×3卷积得到该模型的输出。

3.2. SK-ASSP模块

本文提出了SK-ASSP模块,该模块由自适应ASSP分支和边缘细节优化分支组成。其结构如所示图3. 自适应ASSP分支的前半部分与ASSP模块一致,主要由三个不同扩展速率的atrous卷积并行计算组成(d=1,d=2,d=3)。同时,使用不同扩展率的卷积得到的特征映射在级联之前被分层添加,从而避免了扩展卷积的网格问题[21]. 自适应ASSP分支的后一部分是基于ASSP模块的自适应权重调整。首先,将级联后的特征图进行全局合并,然后通过fc(全连接)层和M向量(M是模块中的空腔卷积数,图中M=3)进行聚合和压缩,再次获得。然后,通过softmax运算获得这三个向量中每个向量的权重。最后将softmax运算后得到的权重与三个扩展卷积的输出相乘,得到带权重的特征映射。 边缘细节优化分支首先进行3×3卷积以获得初始特征图,然后进行门限卷积以确保边缘分支仅处理边界相关信息[22]. 之后,新的特征图将进入边界分支和方向分支。在边界分支中,经过1×1卷积和BN(Batch Normalization)层,进行距离映射以计算与其他对象语义类型的最小距离。在对所有距离图进行聚合后,模型可以得到最终的距离图。在最终距离图中,距离值小于阈值y的所有像素(此处的阈值为5,重点是细化薄边界[23])设置为边界以获得相应的边界图。另一方面,方向分支首先经过1×1卷积和BN层,然后执行Sobel滤波器来计算相应的方向映射(值范围0–360)。每个方向都指向距离对象边界最远的内部像素。整个方向范围分为m类(其中m为8[23]),将每个像素的方向指定给相应的类别,以获得相应的方向映射。最后,将两个分支的映射相乘得到边缘优化特征映射。 最后,添加边缘优化特征图和自适应ASSP特征图,得到最终的特征图。自适应ASSP分支可以获得多尺度密集的空间信息,同时保留更多的细粒度特征,有助于模型对输出进行自适应处理。边缘优化分支可以有效地解决灰度图像中边缘细节模糊的问题[24]. 3.3. 跨模态互补模块

同一图像的不同模式聚焦于不同的特征。RGB模式侧重于图像的颜色和纹理特征,而灰色模式侧重于图片的亮度、结构和形状特征。为了使从RGB图像和灰度图像的两个分支中提取的特征图信息互补,从而进行交叉模式特征融合,本文在CMF模块(交叉模型融合)的基础上进行了改进[25],并提出以下交叉模式互补模块,其结构如所示图4. 本文使用的交叉模式互补模块首先对RGB和灰度图像模式下的特征图输入进行自我注意操作。与传统的自关注操作不同,该自关注操作使用自身模式的Q和V以及另一模式的K作为输入,然后进行第一次信息交互,以建模两种模式下特征图的相关性。

然后,根据原始CMF模块,将获得的自关注向量相加,并在softmax操作后输入到多层感知器MLP中,以及相应的向量α,β然后将各个模式的输入相乘,以获得相应模式下的新特征图。然后将特征映射添加到另一模式的输入特征中,完成两种模式对应特征之间的第二次信息互补,得到两个新的特征映射输出。然后,通过softmax分别对两种模式下的新特征图进行运算,得到相应的权重矩阵αRGB(RGB),β灰色,可用于调整两个输出特征映射的权重。最后,将乘法后得到的结果相加,得到两种模式的互补信息后的特征图。

3.4. 混合并行注意模块

通过在跳跃连接阶段使用混合并行注意机制,在保留长连接结构的同时,可以为子样本结果提供更多的全局信息[26],可以在不同的维度上进行加权,从而实现更准确的人像边缘细节提取。本文使用一个主要由通道注意和位置注意组成的混合注意模块,从通道和坐标两个层次捕获图像的空间信息。其结构如所示图5其中,上部为通道注意模块,下部为位置注意模块。通过学习不同通道的权重,通道注意机制可以减少无效通道的响应,抑制无用特征的激活。位置注意机制通过对任意两个像素建模来表示两个位置的相关性,因此具有相似特征的两个像素可以相互促进并获得更高的权重。 在信道注意模块中,首先将维数降低1×1卷积,然后通过Avgpool和Maxpool对输入的空间信息进行聚合。然后,通过多层感知器MLP,两个空间上下文特征表示一和B中,获得。最后,将这两个特征进行元素合并,并得到相应的通道注意图M(M)如等式(1)所示:哪里σ表示sigmoid函数,多层感知器的隐藏激活大小,MLP公司设置为RC/r×1×1(r是减速比),α_平均值和β_最大值分别表示在AvgPool和MaxPool之后获得的向量。最后,注意力图M(M)乘以输入特征,得到通道注意特征图。 在位置注意模块中,对于输入特征,首先通过1×1卷积进行降维操作,特征C类和D。尺寸与输入特征相同。获得。然后。特征C类被转置并具有特征D类逐像素相乘,以模拟特征地图中任意两个像素的相似性,以及相应的位置注意图P(P)计算结果如式(2)所示:哪里P(P)ij公司表示j个第个像素和我输入特征中的第个点。N个=H×W,其中H和W分别是输入特征的高度和宽度。然后,注意图P(P)与输入特征相乘以获得位置注意力特征。然后将获得的注意图和输入特征相加,得到坐标注意特征。 最后,分别使用1×1卷积将两个注意特征映射恢复到输入维,然后进行特征融合以获得输出映射。

3.5. 损失函数

为了获得图像中目标肖像的上下文信息,本文在模型编码器阶段使用了空卷积。与标准卷积相比,虽然它具有更大的接收场,但其边缘分割精度会降低。Bischke等人[27]提出了一种多损失方法来增强最终的语义分割结果,并使用不同的数据函数对数据结果进行不同方面的约束,对约束模型的输出取得了良好的效果。受此启发,本文的模型通过混合损失来优化语义分割结果,这意味着模型的输出受到两个损失函数的约束。本文中使用的损失函数的组成如下:哪里损失铅表示基于像素损失,损失的空间信息模型代表结构相似性。α和β是偏差参数(其中α+β=1),即逐步提取信息,并对分割的边缘信息和总精度信息进行初步评估和约束。 基于像素的损失:主要用于比较两幅图像之间的像素级差异。它可以分为两部分:第一部分是像素携带的信息总量,用二进制交叉熵表示。第二部分基于像素值间隙测量,比较了分割结果与成对人工生成标签之间的差异。其定义为:哪里N个表示像素数。S公司k个表示拆分标签集,S公司代表一组基本事实,以及P(P)ij公司表示概率。P(P)ij公司基于所有分割像素对的平均值进行计算。这个第页里介于0和1之间,其中0表示分割结果与分割标签相反,1表示分割结果准确无误,每个像素都被准确分类。 空间信息模型:主要用于测量预测样本与实际样本之间的相似程度。因为它考虑了每个像素的局部邻域,所以可以为边界指定更高的权重[28]. 其定义为:哪里x个和年分别表示为两张图片的像素,μx个和μ年是的平均值x个和年、和σx个和σ年是的标准偏差x个和年.C类1设置为0.022,并且C类2设置为0.042以防止分母为0[29]. 结合这两个损失函数,可以在分割过程中有效地优化目标纵向边界的细节,从而提高模型的整体分割精度。

4.实验

4.1. 实验环境

本文的实验主要在python3.8、pytorch1.7、Cuda 11.0环境中进行编码,并在配备Intel i7-11700k CPU(美国加利福尼亚州圣克拉拉)、RTX 3070显卡(美国加利福尼亚州圣克拉拉NVIDIA)和16g内存的计算机上进行训练。选择adam迭代器进行训练,网络参数的初始学习率设置为0.01。经过几次实验,偏差参数α和β在混合损失函数中分别设置为0.3和0.7,批大小设置为16,并进行了100次迭代训练。前50节课进行了冷冻训练,后50节课取消了冷冻训练。

4.2. 数据集

由于人像数据相对珍贵,可用的人像图像数据相对有限。为了更好地训练人像分割网络,本实验主要采用开放的人像数据集进行人像抠图[30]作为基础数据集,然后分析了基于交叉模态高阶推理模型的个性化引导研究项目中教室摄像机拍摄的1000幅肖像图像。此外,还进行了统一规格的裁剪(600×800像素大小),以完成数据集的构建。 由于初始数据集中的图像无法充分模拟实际场景中人像图像中复杂的背景、曝光、天气等因素,本文将使用数据增强来扩展数据量,主要是通过将实际图像中的前景对象合成到新背景上。它主要包括图像颜色调整(对比度调整和亮度调整){0.5,1.5}。图像背景替换(天气效果随机添加{雨、雪、云、阳光}和季节性背景替换{春、夏、秋、冬})。效果如所示图6. 最后,构建了6800个数据集,按照6:2:2的划分比进行划分,其中4080个数据集用作训练数据集,1360个数据集作为验证数据集,以及1360个测试数据集。

4.3. 评估指标

肖像语义分割实际上可以转化为肖像语义标签区域和背景语义标签区域之间的二元分类问题[23]. 在本文中,像素精度PA公司(像素精度)和百万美元评估了(联合平均交集)指数。计算公式如下: 在公式(6)和(7)中,TP(转移定价)表示真实示例(即测试样本中的目标肖像可以准确预测为目标肖像),FN公司表示虚假反例(即测试样本中的肖像背景可以准确预测为成人肖像背景),FP公司表示假阳性示例(即测试样本中的肖像背景可以预测为目标肖像),并且FP公司表示假阳性示例(即测试样本中的肖像背景可以预测为目标肖像)。TN公司代表真实反例(表示测试样本中的肖像背景可以准确预测为成人肖像背景)。在公式(7)中,K(K)表示分类的类别(本实验中为2)。

4.4. 模块消融实验

4.4.1. 基于编码器的烧蚀实验

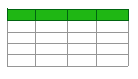

为了验证模型编码器的有效性,使用双分支进行模态信息互补,使用SK-ASSP作为特征提取模块,进行了烧蚀实验,并建立了以下六组网络:Network_1表示U-net基准模型。Network_2使用U-net基本模型和添加灰度图像输入的编码器表示模型。Network_3表示使用U-net基本模型的模型,编码器添加灰度图像输入,并添加跨模态互补模块进行特征融合。Network_4是在Network_3的基础上增加ASSP模块的模型,用于RGB图像和灰度图像的特征提取。Network_5表示在Network_3的基础上将SK-ASSP模块添加到编码器中,并使用自适应ASSP分支对RGB图像和灰度图像进行特征提取的模型。Network_6是在Network_3的基础上,将SK-ASSP模块添加到编码器中,并使用自适应ASSP分支和边缘优化分支对RGB和灰度图像进行特征提取的模型。实验结果如所示表1: 根据表1,与Network_1相比,具有灰度图像输入的Network_2的PA和MIoU分别增加了0.09%和0.11%。在Network_2的基础上,Network_3加上用于特征融合的交叉模式互补模块,与Network_1相比,在PA和MIoU方面分别提高了0.2%和0.24%。与Network_1相比,具有ASSP结构的Network_4改进了PA和MIoU,这证明了空穴卷积可以有效地提高模型的分割精度。与PA和MIoU中的Network_2相比,使用SK-ASSP模块的Network_5和Network_6在ASSP模块的基础上进行了改进,比Network_4有更大的改进。与网络4相比,网络5在PA和MIoU中分别增加了0.45%和0.64%。Network_6在PA和MIoU方面也分别比Network_4有0.2%和0.32%的优势。 4.4.2. 基于注意模块的烧蚀实验

为了验证混合注意模块在跳跃连接阶段的有效性,本文建立了五个基于注意的网络并进行了消融实验。Network_1表示U-net基准模型。Network_2表示在跳转连接阶段引入注意门的注意U-net。Network_3表示U网络模型,在跳跃连接阶段添加了CBAM模块[31]. Network_4表示本文在跳转连接阶段使用的混合注意机制的模型。实验结果如所示表2: 根据表2与Network_1相比,PA和MIoU中引入注意门的Network_2分别增加了0.52%和0.96%,而PA和MIoU中引入CBAM模块的Network_3分别增加了0.94%和1.29%。实验证明,引入注意力机制可以有效地提高分割精度。与Network_3相比,使用通道注意和位置注意的Network_6在PA和MIoU中也有0.14%和0.21%的优势,这证明本文使用的混合注意模块比CBAM模块更能提高纵向语义分割的准确性。 4.4.3. 基于损失函数的烧蚀实验

本文采用基于像素的损失和结构相似性损失组成的加权损失函数。为了验证本文提出的混合损失函数的有效性,并确定偏置参数α和β的最佳值,进行了烧蚀实验。α和β的值范围为0.1至0.9,而α和β值为1。如图所示,当α为0.3,β为0.7时,获得了最佳结果表3. 4.5. 网络比较实验

在本节中,为了评估本文提出的模型的性能,将其与算法模型U-net的评估指标进行了比较[5]、LinkNet[32],纵向网络[33],Deeplab v3+[7]和Trans-UNet[34]. 实验结果如所示表4. 从中可以看出表4,本文提出的算法在两个分割指标PA和MIoU上表现最佳。其中,与本文的基准模型U-net相比,PA和MIoU的改进分别为2.17%和3.42%,这意味着改进是明显的。与基于U-net网络和编码器级剩余结构改进的LinkNet相比,本文模型在PA和MIoU方面分别提高了1.35%和2.36%。与轻量级模型PortraitNet相比,该模型在PA和MIoU方面也具有0.94%和1.15%的优势。同时,与在编码器阶段也使用ASSP模块进行特征提取优化的Deeplab v3+相比,本文的模型在PA和MIoU中也可以提高0.67%和0.79%。最后,与Trans-Unet相比,在编码器阶段引入变压器后,本文的模型在PA和MIoU中也可以领先0.29%和0.32%。同时,该模型的参数个数和平均分割时间均小于Trans-Unet模型。 为了更直观地评估本文研究模型的分割效果,在上图中选择了两组图像来显示每个模型的实际结果的视觉效果。其中,第二组实验图像是低光场景中的肖像分割图像。分割结果如所示图7. 可以看出,U-net模型在图7(a1,a2)。LinkNet和PortraitNet的分割效果优于U-net,但在这两个方面图7(c1,d1),在肖像和表格之间的接触点,被归类为肖像语义的背景出现了某种程度的错误分割。更糟糕的是,在图7(c2,d2),两者都显示出更明显的肖像被误认为背景的现象。Deeplab v3+英寸图7(e1)基本上完成了很好的人像分割,但在手臂等人像的边缘细节上,精度仍需提高。与此同时,在图7(e2)在低光场景中,仍然存在一定的人像丢失现象。在图7(f1,f2),Trans-UNet可以很好地分割目标肖像。然而,它仍然出现在背景中的错误判断,在肖像的左下角的黑暗场景中图7(f2)。与其他语义分割模型相比,本文提出的模型对右袖子和手指等边缘细节具有更好的分割精度图7(g1)。在图7(g2),在弱光场景中,人像保存最完整,背景辨别,如手臂和身体之间的间隙,比其他语义分割模型更接近标准分割结果,分割精度最好。 5.结论

本文提出了一种新的基于双模信息互补的语义分割方法,该方法主要是基于U-net基本模型结构设计的。该模型使用RGB图像和灰度图像两种模式图像,解决了当前基于U网的语义分割模型在面对不同尺寸的人像边缘时分割精度较差的问题,并且在低光场景中容易出现分割错误现象。

我们还建议将SK-ASSP模块作为特征提取模块,分别提取两个模态图像的特征。SK-ASSP模块可以针对不同大小的人像自适应调整卷积核权重。同时,利用方向映射和距离映射有效地优化了人像的边缘分割精度。然后,我们使用交叉模态互补模块交换两个模态的特征图上的信息。在跳跃连接阶段,编码器和解码器通过混合并行注意模块连接,特征映射在通道和坐标维上建模,并在空间和通道维上挖掘肖像图像的像素上下文信息。

基于上述改进,本文的模型在基于人体模型的增强数据集中表现良好,在PA和MIoU中分别达到96.89%和95.48%,这比本文的基准模型U-net在PA和MIoU中都有较大的改进;同时,它比语义分割模型LinkNet、PSPNet、deeplab v3+和Trans-UNet具有更高的分割精度。在实际的图像分割效果中,本文的模型对人像边缘分割的细节,如指尖具有较好的分割效果。未来,我们将重点关注如何通过减少模型参数的数量来减轻模型的重量,同时保持模型的高精度,并获得更易于部署的纵向语义分割模型。