多样性、公平性和包容性

我们对多样性的承诺

支持多元化团队

公平且员工赋权的审查流程 慷慨的学费和专业会员报销 大力支持需要帮助获得签证担保的员工 商务旅行期间对儿童保育要求的财务支持 生育、收养或抚养的带薪育儿假和产假

AI2还支持更广泛社区中与DEI相关的倡议

通过研究揭示DEI挑战

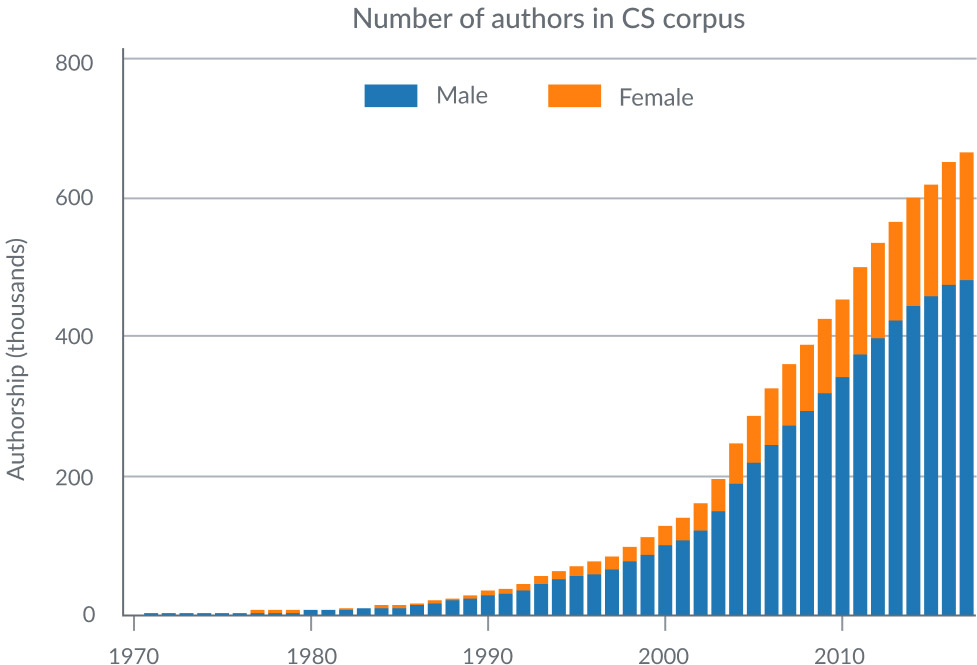

计算机科学中的性别趋势

对抗性性别删除

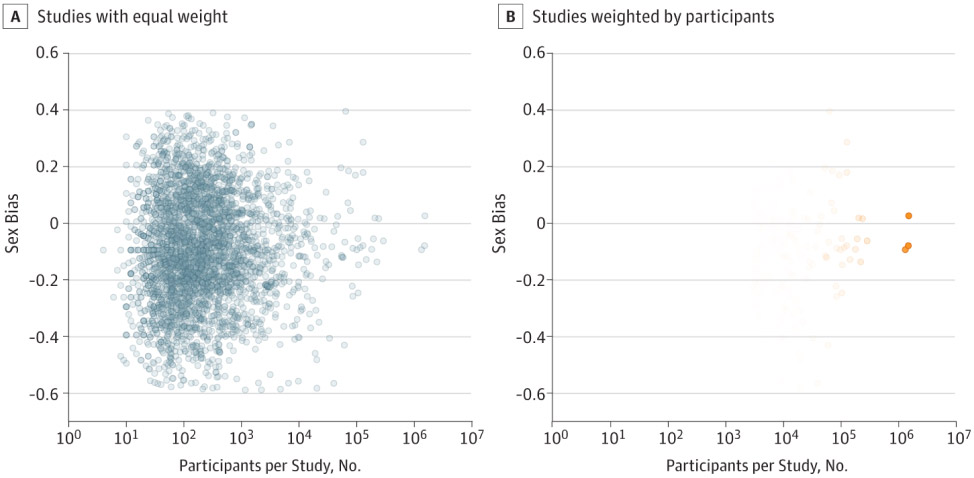

量化性别偏见

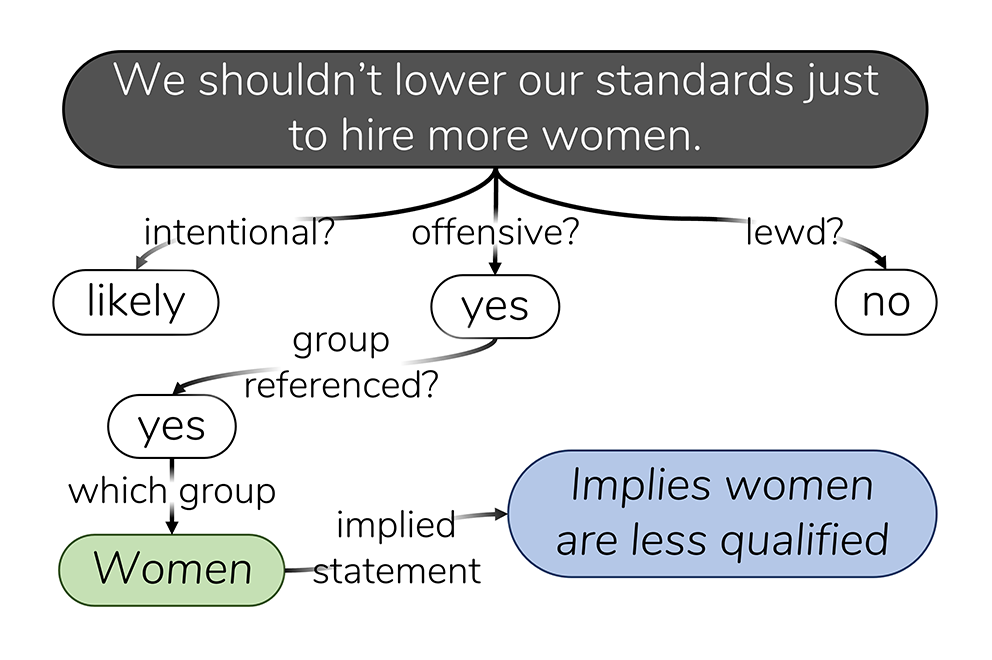

反对偏见和有毒语言