AI政策新闻

CAIDP向FTC提交AI投诉

新闻中的CAIDP

-

对智能机器的愤怒 , ACM新闻, 2023年4月11日 -

技术政策小组鼓励FTC阻止OpenAI 分发GPT-4 , 顶级动作 2023年4月12日 -

美国开始研究可能的规则来规范人工智能,比如ChatGPT, 路透社 2023年4月11日 -

ChatGPT引发跨大西洋监管威胁 情报 , 观察员, 2023年4月5日 -

Snapchat为其AI聊天机器人添加了新的保护措施, TechCrunch、, 2023年4月5日 -

联邦隐私监察机构在投诉后调查OpenAI、ChatGPT , CBC、, 2023年4月4日 -

新规则创新拖船的生成人工智能工具中心 战争 , 烈火, 2023年4月5日 -

拜登关注人工智能的危险,称科技公司必须确保产品安全 , 雅虎财经/ 路透社, 2023年4月4日 -

拜登将在周二与科学顾问会面时讨论人工智能的风险 , 路透社, 2023年4月4日 -

GPT-4遭到攻击:AI政策小组呼吁FTC调查OpenA。 技术总裁 2023年4月3日 -

非营利组织投诉敦促调查OpenAI GPT模型, 梅纳FN, 2023年4月2日 -

ChatGPT被禁止 意大利因隐私问题 , 《纽约时报》, 2023年4月1日 -

你陶醉于ChatGPT的成功吗?…” 商业降级“开放人工智能 每天都在挣扎, 韩国,INEWS-242023年4月2日 -

美国倡导组织要求联邦贸易委员会停止新的OpenAI GPT发布, 路透社 2023年3月31日 -

OpenAI面临联邦贸易委员会的投诉,要求调查和暂停ChatGPT 发布 , 中国广播公司财经频道 2023年3月31日 -

GPT-4带来太多风险,应暂停发布,AI集团 告诉联邦贸易委员会 , ArsTechnica公司 2023年3月31日 -

这个 AI政策团体声称,FTC应调查OpenAI并阻止GPT的“欺骗”行为 , CNN公司 2023年3月30日 -

非营利组织表示,联邦贸易委员会需要调查OpenAI并停止GPT-4, 澳大利亚PCmag, 3月30日, 2023 -

AI道德组织称ChatGPT违反联邦贸易委员会规则,要求调查, 小发明 , 2023年3月30日 -

在联邦贸易委员会投诉后,OpenAI可能不得不停止ChatGPT的发布, Engadget公司, 2023年3月30日 -

OpenAI面临联邦贸易委员会的投诉,要求调查和暂停ChatGPT 发布 , 中国广播公司财经频道 2023年3月30日 -

阻止OpenAI发布更多ChatGPT 版本:美国集团至FTC , 印度时报 2023年3月30日 -

OpenAI的ChatGPT面临美国联邦贸易委员会的投诉,呼吁欧洲监管机构介入 , 财富, 2023年3月30日 -

联邦贸易委员会应停止新的开放式人工智能GPT发布,并调查、倡导团体 说 第页, MLex公司, 2023年3月30日 -

AI政策小组表示,FTC应阻止OpenAI推出新的GPT模型 , 科技博客 2023年3月30日 -

Elon Musk呼吁暂停人工智能开发“完全正确”:Marc 罗滕伯格, 福克斯新闻 2023年3月29日 -

Elon Musk、Steve Wozniak和其他技术领导者警告称,人工智能姿势“失控” “巨大风险” 美国广播公司新闻 2023年3月29日

AI政策资源

CAIDP声明

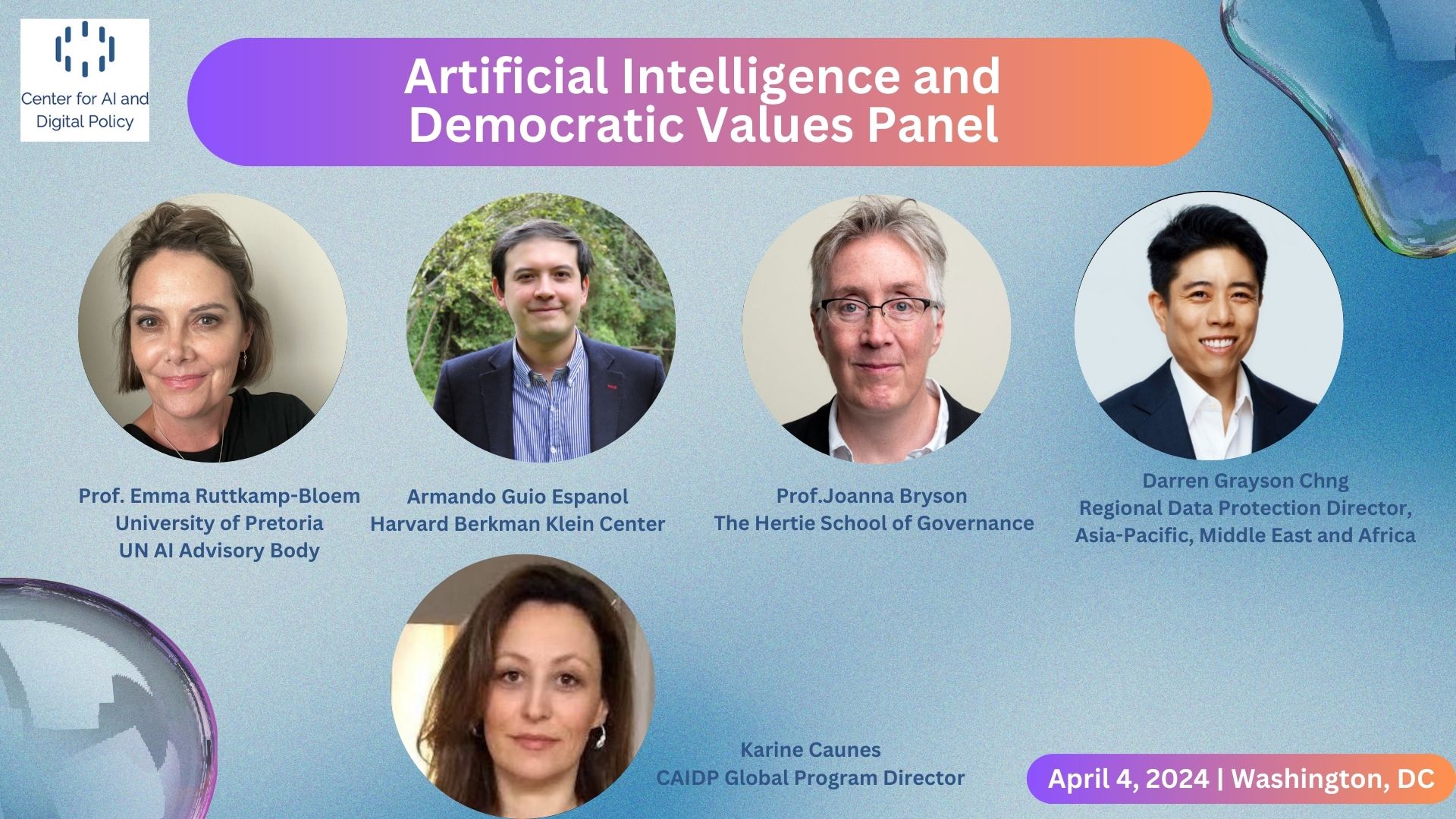

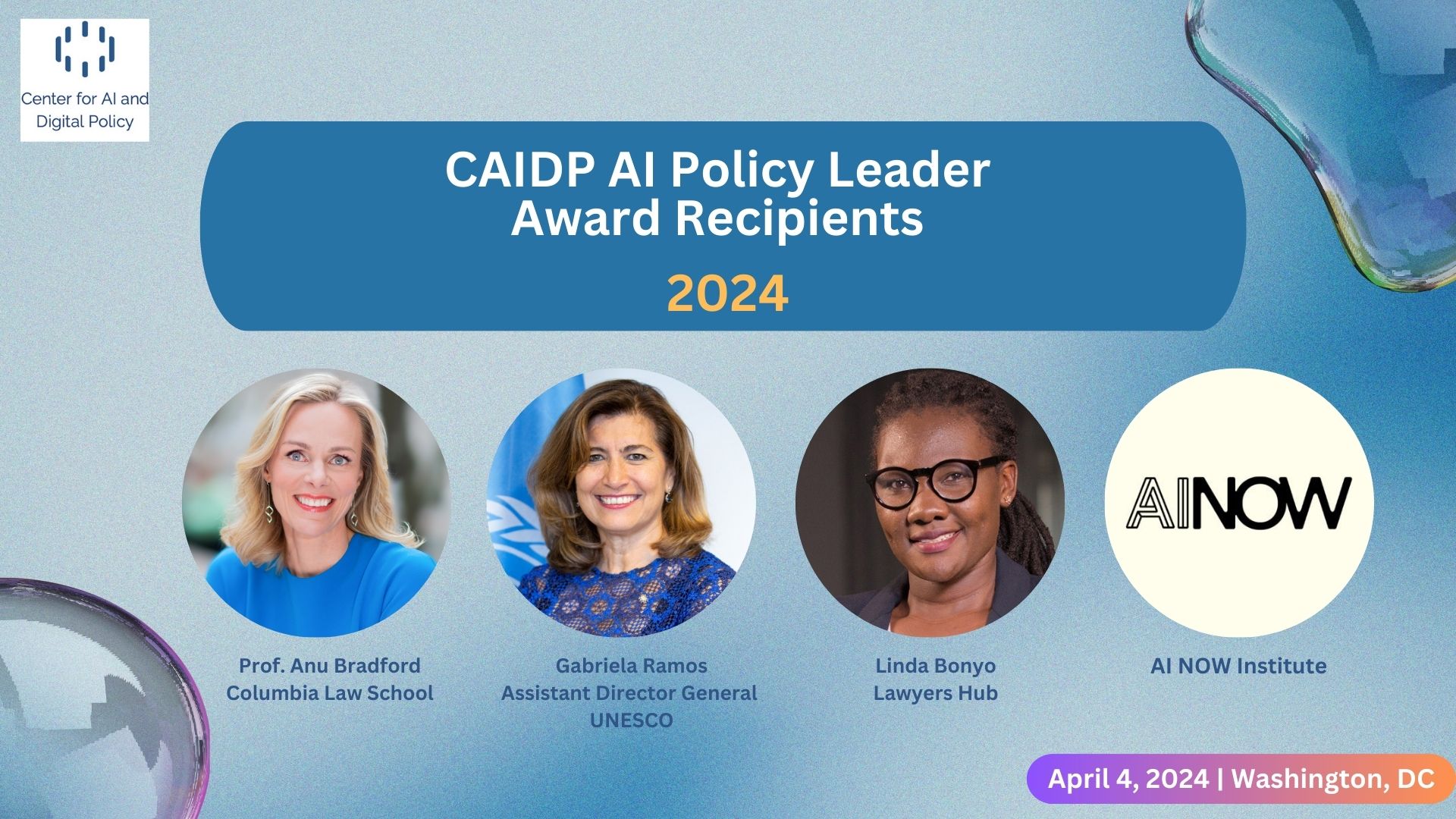

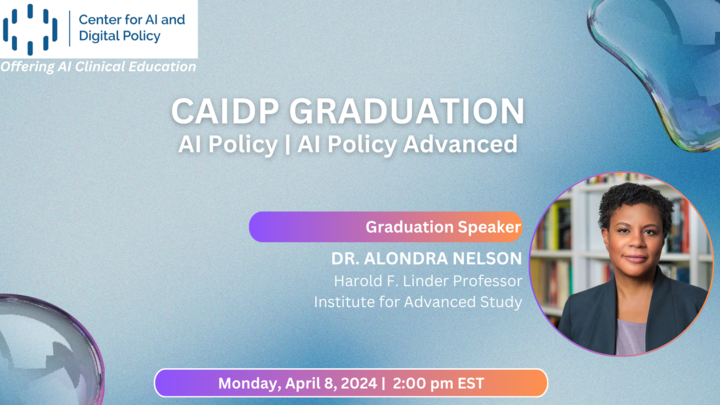

AI策略事件

CAIDP活动

人工智能通用指南

评论

参考书

The

近期出版物

AI伦理书店

值得注意的

“……一个科技发达的世界 促进 基于基本权利、民主的广泛社会包容 机构 以及法治。 ”

马克 Rotenberg–AI政策评论